São Paulo — InkDesign News —

A inteligência artificial (IA), particularmente o machine learning, continua a ser uma área de intensa pesquisa e debate. Cientistas e especialistas compartilham visões divergentes sobre seu potencial e limitações, especialmente em relação aos modelos de linguagem generativa.

Contexto da pesquisa

Gary Marcus, professor da Universidade de Nova York e crítico proeminente de IA, reafirma suas preocupações sobre a eficácia dos modelos de linguagem generativa, como os large language models (LLMs). Em uma conferência recente, Marcus destacou que “os LLMs são inerentemente falhos, e nunca entregarão as promessas grandiosas do Vale do Silício” (“the LLMs are inherently broken, and will never deliver on Silicon Valley’s grand promises”).

Método proposto

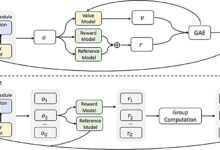

Marcus propõe uma abordagem diferente chamada IA neurosimbólica, que busca reconstruir a lógica humana artificialmente. Ao contrário dos métodos baseados apenas em grandes conjuntos de dados, esse modelo visa integrar raciocínio e simbolismo na criação de sistemas de IA, podendo assim superar as limitações dos modelos atuais.

Resultados e impacto

Embora os métodos tradicionais baseado em LLMs tenham demonstrado eficácia em tarefas como assistência na codificação e geração de texto, eles falham em fornecer resultados precisos em áreas onde “as respostas corretas realmente importam” (“there are too many white-collar jobs where getting the right answer actually matters”). Marcus sugere que essa limitação pode atrasar o progresso em direção a uma IA mais eficaz e abrangente.

“Uma consequência de focar tudo nos LLMs é que qualquer abordagem alternativa que poderia ser melhor fica à margem”

(“One consequence of going all-in on LLMs is that any alternative approach that might be better gets starved out.”)— Gary Marcus, Professor, Universidade de Nova York

Além disso, os desafios de “alucinações” em IA, onde os modelos produzem erros confiantes, precisam ser abordados. Marcus relata um encontro com Reid Hoffman, onde este apostou que os problemas de alucinações seriam resolvidos rapidamente, indicando a dificuldade desses desafios na prática. O uso de IA generativa é visto como limitado, por sua alta demanda computacional e falta de diferenciação no mercado.

“Estão sendo úteis principalmente para auto-completar funções: programação, brainstorming e tarefas similares” ( “They’re very useful for auto-complete on steroids: coding, brainstorming, and stuff like that.”). Contudo, a monetização dessa tecnologia levanta preocupações sobre vigilância e privacidade, dado o valor dos dados dos usuários. As implicações são vastas e demandam atenção cuidadosa sobre a direção da pesquisa e desenvolvimento em IA.

Próximos passos podem incluir o avanço na pesquisa sobre IA neurosimbólica como uma alternativa viável aos LLMs, potencialmente oferecendo resultados mais relevantes e úteis para a sociedade.

Fonte: (TechXplore – Machine Learning & AI)