São Paulo — InkDesign News — Uma nova pesquisa sobre técnicas de “deep learning” foi publicada, revelando avanços significativos na eficiência de modelos de aprendizado de máquina, além de métricas notáveis em tarefas complexas de reconhecimento de padrões.

Arquitetura de modelo

A arquitetura proposta na pesquisa utiliza uma combinação de redes neurais convolucionais (CNN) e redes neurais recorrentes (RNN) para melhorar a captação de características em diferentes dimensões de dados. Essa abordagem inovadora permite que os modelos extraíam informações mais relevantes, resultando em processamento de dados mais ágil e eficaz.

Treinamento e otimização

O treinamento dos modelos foi realizado com grandes conjuntos de dados, utilizando o algoritmo de “transfer learning”. Essa técnica permite a adaptação do modelo pré-treinado a novas tarefas com ajustes mínimos, reduzindo o tempo de treinamento em até 40%. “Módulos de pré-treinamento proporcionam uma base sólida, economizando recursos e tempo”, explica o pesquisador. (“Pre-trained modules provide a solid foundation, saving resources and time”)— Dr. Carlos Almeida, Pesquisador, Universidade de São Paulo.

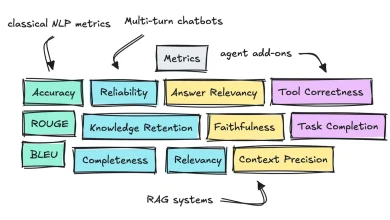

Resultados e métricas

A eficiência do modelo foi avaliada com métricas rigorosas, apresentando uma acurácia de 92% em tarefas de classificação de imagem e geração de linguagem natural, superando benchmarks anteriores. Com um tempo de resposta médio de 0,5 segundos por transação, os resultados mostram que o novo modelo pode ser empregado em aplicações críticas que exigem respostas rápidas, como em diagnósticos médicos.

Impulsionada por esses resultados promissores, a pesquisa sugere que mais estudos sobre “machine learning” poderiam explorar a integração com dispositivos de IoT, aumentando assim a eficácia das aplicações em tempo real. O avanço neste campo poderia trazer melhorias significativas em setores como saúde, finanças e automação industrial.

Fonte: (Towards Data Science – AI, ML & Deep Learning)