São Paulo — InkDesign News —

Pesquisadores da Universidade da Califórnia do Sul (USC) estão desenvolvendo novos frameworks de “machine learning” que visam melhorar a capacidade da inteligência artificial (IA) em tomar decisões sob incerteza. Esta pesquisa é especialmente relevante em um mundo onde a capacidade de fazer escolhas informadas pode impactar diversas áreas.

Contexto da pesquisa

A complexidade das decisões enfrentadas por sistemas de IA, assim como a natureza incerta do mundo real, tornou evidente a necessidade de incorporação de princípios da teoria da decisão e da teoria da utilidade. Willie Neiswanger, professor assistente de ciência da computação na USC, lidera esta investigação junto a seus estudantes.

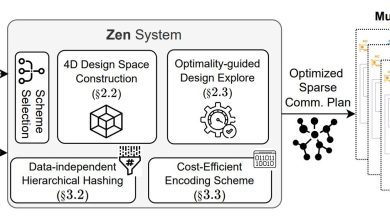

Método proposto

Neiswanger e sua equipe desenvolveram um modelo de “large language model” (LLM) focado em quantificação de incerteza. O método ensina as máquinas a medir e expressar níveis de confiança nas previsões, permitindo que decisões sejam tomadas mesmo com informações incompletas. O modelo obtém probabilidades numéricas a partir de variáveis incertas, como produção agrícola ou preços do mercado, baseado em dados históricos e relatórios contextuais.

“Focamos em melhorar a capacidade de uma máquina de quantificar incertezas, essencialmente ensinando-a a medir e expressar quão confiante deve estar sobre diferentes previsões.”

(“We focused on improving a machine’s ability to quantify uncertainty, essentially teaching it to measure and express how confident it should be about different predictions.”)— Willie Neiswanger, Professor Assistente, Universidade da Califórnia do Sul

Resultados e impacto

Entre os impactos potenciais, a aplicação deste modelo pode beneficiar áreas como planejamento estratégico no mundo dos negócios, oferecendo avaliações mais realistas das incertezas de mercado e dinâmicas competitivas. Em contextos médicos, pode fornecer suporte diagnóstico mais eficaz. A capacidade de alinhar as decisões da IA com as preferências humanas é um dos pontos fortes, permitindo que as recomendações não sejam apenas tecnicamente eficazes, mas também aceitáveis na prática.

Os próximos passos do grupo incluem a exploração de aplicações mais amplas nas áreas de pesquisa operacional e saúde. A equipe visa também aprimorar a auditabilidade humana, oferecendo interfaces que expliquem claramente as decisões tomadas por LLMs.

Fonte: (TechXplore – Machine Learning & AI)