Framework de AI reduz uso de memória e melhora eficiência energética

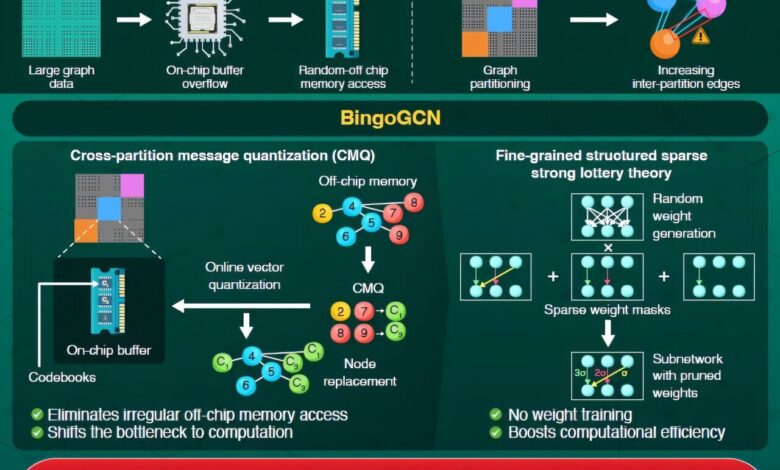

São Paulo — InkDesign News — Um novo avanço em machine learning promete revolucionar a análise em tempo real de grandes dados em grafo. Pesquisadores do Instituto de Ciência de Tóquio (Japão) desenvolveram o BingoCGN, um acelerador de rede neural que aumenta a eficiência computacional e reduz o uso de memória.

Contexto da pesquisa

As redes neurais em grafo (GNNs) são modelos de inteligência artificial (AI) projetados para analisar dados complexos e não estruturados em formato de grafo. Esses dados representam entidades como nós e suas conexões como arestas. Apesar do potencial das GNNs em aplicações como redes sociais e descoberta de medicamentos, a análise em tempo real de grandes grafos ainda enfrenta desafios críticos.

Método proposto

O BingoCGN utiliza uma técnica inovadora chamada quantização de mensagens entre partições (CMQ), que resume o fluxo de mensagens entre as partições e elimina a necessidade de acesso irregular à memória off-chip. “BingoCGN emprega uma nova técnica chamada cross-partition message quantization (CMQ) que resume o fluxo de mensagens inter-partições, eliminando acesso irregular à memória off-chip e aumentando a eficiência computacional” (BingoCGN employs a new technique called cross-partition message quantization (CMQ) that summarizes inter-partition message flow, eliminating irregular off-chip memory access and boosting computational efficiency) — Daichi Fujiki, Professor Associado, Instituto de Ciência de Tóquio.

Resultados e impacto

Os testes realizados em sete conjuntos de dados do mundo real demonstraram um aumento de até 65 vezes na velocidade de inferência e um incremento de até 107 vezes na eficiência energética em comparação ao acelerador FlowGNN. Isso posiciona o BingoCGN como uma solução promissora para o processamento de grafos em larga escala, essencial para aplicações que exigem decisões em tempo real.

Com a combinação de quantização de mensagens e uma nova abordagem de treinamento baseada na teoria do bilhete de loteria, o modelo resulta em uma rede subjacente mais eficiente e com menor densidade de parâmetros. Isso abre possibilidades para processamento em tempo real de dados complexos em diversas aplicações futuras.

Fonte: (TechXplore – Machine Learning & AI)