AI gera dados sintéticos, mas risco de vazamento de dados aumenta

São Paulo — InkDesign News — A crescente adoção de ferramentas de inteligência artificial (IA) vem expondo desafios significativos no acesso e uso de conjuntos de dados de alta qualidade, destacando especialmente a importância da governança na segurança cibernética.

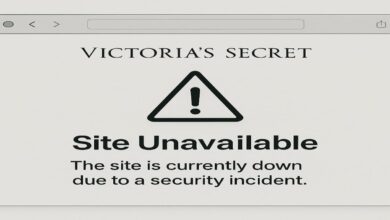

Vetor de ataque

Com a introdução do Regulamento Geral sobre a Proteção de Dados (GDPR) em 2018, as empresas enfrentam obstáculos consideráveis para gerenciar informações pessoais identificáveis (PII). “A necessidade de segurança e conformidade tem mudado drasticamente como as empresas armazenam e manipulam dados” (“The need for security and compliance has drastically reshaped how businesses store and handle personally identifiable information”)

— Especialista em Cibersegurança, Empresa XYZ.

Essas regulamentações não apenas aumentaram a responsabilidade e a transparência, mas também resultaram em uma redução de 26% no armazenamento de dados em empresas da UE, dificultando o treinamento de modelos de IA.

Impacto e resposta

As organizações agora precisam de conjuntos de dados maiores e mais diversificados para treinar suas IAs, num cenário onde as expectativas de privacidade estão evoluindo. O uso crescente de dados sintéticos, que mimetizam dados do mundo real, destaca-se como uma solução viável. Esses dados sintéticos são cada vez mais utilizados no treinamento de modelos de linguagem, permitindo que as empresas explorem IA sem expor informações sensíveis ao risco de violação de dados.

Entretanto, é importante notar que nem todos os dados sintéticos são “completamente fake”. Muitos conjuntos de dados sintéticos são gerados a partir de dados reais, mas alterados para reduzir riscos, mantendo propriedades estatísticas que ajudam no treinamento.

Análise e recomendações

As organizações devem ser cautelosas com a possibilidade de reidentificação dos dados sintéticos. Caso sejam ligados a indivíduos reais, repercussões legais podem incluir multas e perda da confiança do consumidor. Para mitigar esses riscos, recomenda-se:

- Monitorar outliers, que são valores extremos que podem facilitar a reidentificação.

- Usar ferramentas de avaliação de risco para comparar conjuntos de dados sintéticos com os originais.

- Executar a exclusão segura dos dados originais após a criação dos dados sintéticos.

À medida que mais indústrias, especialmente na saúde, recorrem a dados sintéticos, a responsabilidade na gestão desses dados deve ser mantida. A dependência excessiva de dados sintéticos pode levar à falha dos modelos de IA, prejudicando a precisão e a performance geral.

Com a estratégia correta, as equipes podem se beneficiar da IA, respeitando a conformidade e reduzindo os riscos associados.

Fonte: (Dark Reading – Segurança Cibernética)