São Paulo — InkDesign News —

O uso do algoritmo XGBoost em machine learning tem mostrado resultados promissores na performance e eficiência em comparação a outros métodos baseados em árvores. Este artigo investiga técnicas de otimização de hiperparâmetros para maximizar a eficácia do modelo.

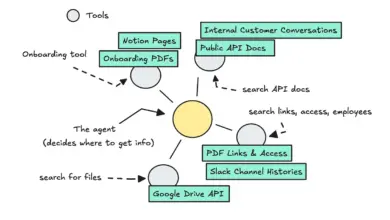

Arquitetura de modelo

O XGBoost é um algoritmo gradient boosting que se destaca pela sua capacidade de lidar com grandes volumes de dados e melhorar a precisão. A arquitetura do modelo é complexa, exigindo configuração de diversos hiperparâmetros durante o processo de ajuste.

Treinamento e otimização

No que diz respeito ao ajuste de hiperparâmetros, métodos tradicionais como a busca em grade (grid search) foram comparados à abordagem mais avançada do Hyperopt com Tree-Structured Parzen Estimators (TPE).

A descrição de Harrison indica que é “usando otimização bayesiana para identificar combinações de hiperparâmetros.”

(“using Bayesian optimization to identify hyperparameter combinations.”)— Matt Harrison, Autor e Cientista de Dados

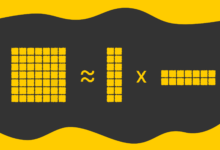

O método TPE evita a natureza exaustiva da busca em grade ao desenvolver um modelo "substituto" que antecipa a performance de combinações de hiperparâmetros, economizando tempo e recursos computacionais.

Resultados e métricas

Estudos demonstraram que expandir o espaço de busca pode ser contraproducente. A pesquisa contra modelos treinados em um espaço de busca mais amplo mostrou que a predição e a acurácia não se elevaram proporcionalmente ao aumento do tempo de treinamento. No teste, modelos com um espaço de busca reduzido apresentaram log loss e métricas de precisão similares, mas com tempos de treinamento significativamente menores.

O “modelo do percentil 20-80 apresentou uma perda de log validação ligeiramente melhor.”

(“the 20-80 Percentile model showed slightly better validation log loss.”)— Análise de dados, Estudo de caso

A pesquisa evidencia que um ajuste mais focado nos hiperparâmetros pode acelerar o processo de modelagem sem sacrificar a precisão, apresentando uma realidade prática onde o tempo de execução é um fator crítico.

As aplicações práticas deste tipo de análise são vastas, especialmente em setores que exigem decisões rápidas baseadas em análises preditivas, como finanças e saúde. O próximo passo seria investigar o impacto de adicionar mais hiperparâmetros a este modelo, ampliando as capacidades do XGBoost em diferentes domínios.

Fonte: (Towards Data Science – AI, ML & Deep Learning)