AI detecta e mitiga viés em redes sociais com machine learning

São Paulo — InkDesign News — Uma nova aplicação de machine learning foi desenvolvida para abordar o viés nas interações em comunidades online, com foco em promover um ambiente digital mais seguro e inclusivo.

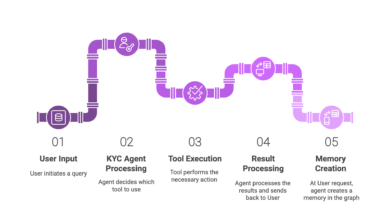

Arquitetura de modelo

A arquitetura se baseia em uma pipeline de três fases: coleta, detecção e mitigação. Na fase de coleta, foram utilizados 1 milhão de postagens do Twitter e 1 milhão de comentários do Reddit. Esses dados foram limpos e deduplicados, e recursos de metadados foram preparados para auxiliar no treinamento dos modelos. RoBERTa e DistilBERT foram escolhidos como os modelos principais para a classificação e detecção de viés.

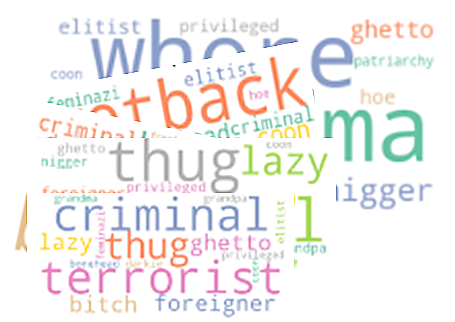

O treinamento dos modelos envolveu a anotação de viés, onde as expressões eram classificadas em viés explícito e implícito. O viés explícito é caracterizado por ofensas diretas, enquanto o viés implícito é mais sutil, como a utilização de estereótipos. Através de técnicas de NLP e a implementação de modelos de transformadores, o sistema conseguiu capturar nuances e escopos de linguagem.

Treinamento e otimização

O RoBERTa alcançou 98,6% de acurácia na validação, enquanto o DistilBERT teve um impressionante F1 score de 0,99. Durante as iterações de treinamento, as curvas de perda mostraram uma rápida convergência, permitindo uma separação clara das classes no modelo. Além disso, a validação contínua foi essencial para ajustar as hiperparâmetros e garantir robustez contra problemas de overfitting.

A abordagem modular facilita a integração do sistema em plataformas existentes, prometendo escalabilidade. Estratégias de mitigação foram aplicadas de maneira em tempo real, permitindo que respostas aos comentários viessem de um moderador virtual, o JenAI-Moderator, que mantém uma voz consistente e adaptável.

Resultados e métricas

Os testes realizados em mais de dois milhões de comentários revelaram que 4% das interações continham viés, predominantemente relacionado a raça, gênero, e idade. As respostas geradas pelo JenAI-Moderator foram avaliadas positivamente por revisores humanos, mostrando aderência contextual e precisão, especialmente nos casos de viés implícito.

Uma consideração importante é que a moderação não deve ser apenas um processo técnico, mas também uma interação que promove uma cultura de aprendizado. Isso implica que o sistema deve ser capaz de reconhecer o tom da interação, proporcionando correções firmes para o viés explícito enquanto apresenta sugestões educacionais para o viés implícito.

As próximas etapas da pesquisa incluem estudos de usuários para avaliar a recepção do sistema e pilotagens para testar confiança e engajamento. A intenção é fortalecer a robustez contra tentativas de driblar o sistema, assim como expandir para conjuntos de dados multilíngues, promovendo a equidade em um contexto global.

Fonte: (Towards Data Science – AI, ML & Deep Learning)