Contexto da pesquisa

A equipe de cientistas da computação da Universidade da Califórnia em Riverside (UC Riverside) desenvolveu um método para remover dados privados e protegidos por direitos autorais de modelos de inteligência artificial (IA), sem precisar de acesso aos dados de treinamento originais. A pesquisa, apresentada em julho na Conferência Internacional sobre Aprendizado de Máquina em Vancouver, Canadá, aborda preocupações crescentes sobre a permanência de materiais pessoais e protegidos em modelos de IA, mesmo após tentativas de remoção pelos criadores.

Método proposto

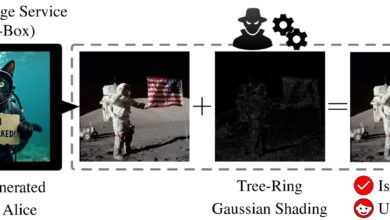

O método, denominado “aprendizado não certificado sem dados de fonte” (source-free certified unlearning), utiliza um conjunto de dados substituto que estatisticamente se assemelha aos dados originais. Este sistema ajusta os parâmetros do modelo e adiciona ruído aleatório calibrado para garantir que a informação específica seja apagada de forma irrecuperável. Essa abordagem evita a necessidade de reconstruir o modelo a partir dos dados originais, que é um processo custoso e que exige muita energia.

“Em situações do mundo real, você nem sempre pode voltar e obter os dados originais.”

(“In real-world situations, you can’t always go back and get the original data.”)— Ümit Yiğit Başaran, Doutorando, UC Riverside

Resultados e impacto

Os pesquisadores validaram seu método utilizando conjuntos de dados sintéticos e reais, e os resultados mostraram que as garantias de privacidade são semelhantes às obtidas com o treinamento completo do modelo, mas com um uso de computação significativamente menor. Embora a pesquisa atual se aplique a modelos mais simples, os autores acreditam que eventualmente a técnica poderá ser ampliada para sistemas complexos, como o ChatGPT.

“As pessoas merecem saber que seus dados podem ser apagados de modelos de aprendizado de máquina — não apenas em teoria, mas de formas prováveis e práticas.”

(“People deserve to know their data can be erased from machine learning models—not just in theory, but in provable, practical ways.”)— Başak Güler, Professora Assistente, UC Riverside

Os próximos passos da pesquisa incluem a adaptação do método para funcionar com tipos de modelos mais complexos e a criação de ferramentas que tornem essa tecnologia acessível a desenvolvedores de IA em todo o mundo.

Fonte: (TechXplore – Machine Learning & AI)