Machine learning ensina robôs a usar ferramentas por observação

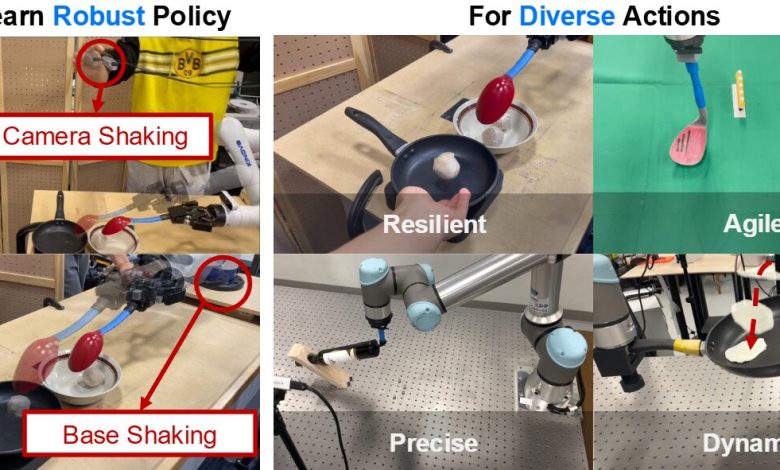

Machine learning está em constante evolução, e uma nova pesquisa mostra que robôs podem aprender a usar ferramentas apenas assistindo a vídeos de humanos, expandindo as fronteiras da adaptabilidade e usabilidade dos robôs.

Contexto da pesquisa

A equipe da Universidade de Illinois em Urbana-Champaign, em colaboração com universidades como Columbia e UT Austin, investigou como os robôs poderiam aprender habilidades complexas de uso de ferramentas através da observação de vídeos. O avanço é significativo, uma vez que a maioria dos robôs atuais é programada para tarefas específicas e repetitivas.

Método proposto

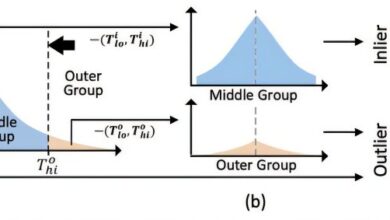

O estudo introduziu um novo modelo chamado “Tool-as-Interface“, que permite que robôs aprendam com vídeos comuns de pessoas executando tarefas cotidianas. O processo envolve um modelo de visão intitulado MASt3R, que reconstrói um modelo tridimensional da cena a partir de duas visões de vídeo. A seguir, uma técnica de renderização chamada “3D Gaussian splatting” gera ângulos adicionais para que o robô “veja” a ação de diferentes perspectivas.

“Nosso objetivo é ensinar robôs habilidades dinâmicas complexas de uso de ferramentas apenas com vídeos comuns de pessoas realizando tarefas do dia a dia.”

(“The goal is straightforward: teach robots complex, dynamic tool-use skills using nothing more than ordinary videos of people doing everyday tasks.”)— Haonan Chen, Autor Principal, Universidade de Illinois em Urbana-Champaign

Resultados e impacto

Os resultados mostraram um aumento de 71% nas taxas de sucesso em comparação com métodos tradicionais de teleoperação. O sistema testou cinco tarefas: martelar um prego, pegar uma almôndega, virar alimentos em uma panela, equilibrar uma garrafa de vinho e chutar uma bola de futebol. As melhorias foram também notáveis no tempo de coleta de dados, com uma redução de 77% em comparação com métodos anteriores.

“O robô não hesitou, apenas se adaptou, mesmo quando um humano jogou mais meatballs durante a tarefa.”

(“The robot didn’t hesitate, it just adapted, even when a human tossed in more meatballs mid-task.”)— Pesquisa na Universidade de Illinois

O próximo passo envolve aprimorar o sistema para tratar a utilização de ferramentas menos rígidas e melhorar a estimativa de pose. As possibilidades futuras incluem a aplicação dessa tecnologia em vídeos do cotidiano, permitindo que robôs aprendam e se adaptem a uma variedade de tarefas com menor esforço de engenharia.

Esse avanço transforma o vasto acervo de vídeos humanos em potenciais bibliotecas de treinamento para a próxima geração de robôs que aprendem e se adaptam de forma mais natural.

Fonte: (TechXplore – Machine Learning & AI)