São Paulo — InkDesign News —

A crescente adoção de ferramentas de inteligência artificial (IA), especialmente as baseadas em modelos de linguagem de grande escala (LLM), está moldando o cenário do desenvolvimento de software. Segundo dados da pesquisa de desenvolvedores de 2025 do Stack Overflow, 84% dos desenvolvedores já utilizam ou planejam utilizar essas ferramentas, embora a confiança nelas esteja diminuindo.

Tecnologia e abordagem

Modelos como GPT e LLMs estão na vanguarda da programação assistida por IA, prometendo aumentar a produtividade por meio de sugestões automatizadas que tornam o desenvolvimento mais ágil. No entanto, o estudo revela um fenômeno alarmante: 66% dos desenvolvedores enfrentam soluções geradas que são “quase corretas, mas não exatamente” adequadas, resultando em um aumento do tempo de depuração.

Um dos achados mais surpreendentes foi uma mudança significativa nas preferências dos desenvolvedores em relação à IA, pois, embora a maioria os utilize, eles a apreciam e confiam menos este ano.

(“One of the most surprising findings was a significant shift in developer preferences for AI compared to previous years, while most developers use AI, they like it less and trust it less this year.”)— Erin Yepis, Analista Sênior, Stack Overflow

Aplicação e desempenho

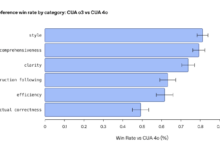

Os dados mostram que a precisão dos outputs de IA caiu de 43% em 2024 para 33% em 2025. Apesar de sua popularidade, 45% dos desenvolvedores relatam que a depuração de códigos gerados por IA consome mais tempo do que o esperado. As ferramentas de geração de código falham em lidar com a complexidade, com apenas 29% dos desenvolvedores acreditando que elas podem resolver problemas complexos. Essa situação resulta em um novo tipo de "dívida técnica", já que o tempo gasto para corrigir problemas supera os benefícios da automação.

Impacto e mercado

A rápida adoção de soluções de IA superou as capacidades de governança das empresas. Embora as ferramentas de IA possam auxiliarem-se, o seu uso descontrolado pode levar a riscos de segurança e à produção de códigos vulneráveis. Além disso, 61,7% dos desenvolvedores ainda preferem suporte humano para garantir a qualidade do código devido a preocupações éticas e de segurança.

A codificação ‘vibe’ requer um nível mais alto de confiança na saída da IA, sacrificando a confiança e potenciais preocupações de segurança pelo um retorno mais rápido.

(“Vibe coding requires a higher level of trust in the AI’s output, and sacrifices confidence and potential security concerns in the code for a faster turnaround.”)— Ben Matthews, Diretor Sênior de Engenharia, Stack Overflow

Com essa dinâmica, as empresas devem investir em processos robustos de revisão de código e em treinamento adequado para seus desenvolvedores, focando não somente na adoção, mas na integração efetiva de IA em seus fluxos de trabalho. O futuro da programação pode depender não apenas de quão rapidamente as empresas implementam essas tecnologias, mas de como elas gerenciam a qualidade e a segurança dos códigos gerados.

Fonte: (VentureBeat – AI)