O uso de machine learning (ML) está se expandindo para contextos de verificação de informações, com uma nova abordagem proposta para integrar Inteligência Artificial (IA) no sistema de notas da plataforma X, anteriormente conhecida como Twitter.

Contexto da pesquisa

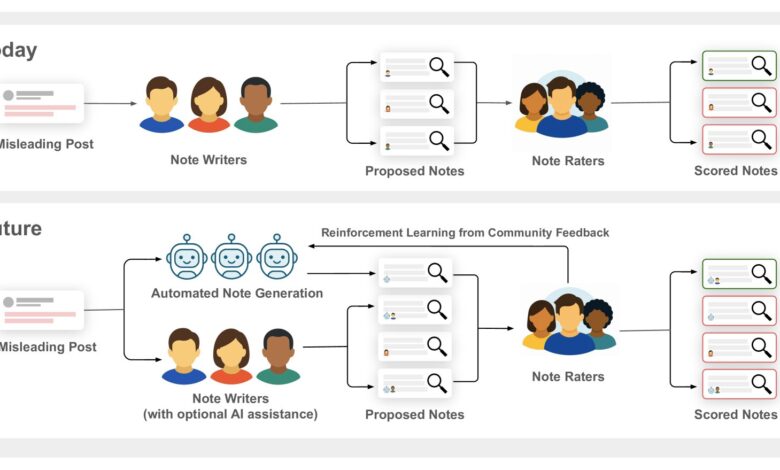

A iniciativa “Community Notes” da X visa combater a desinformação, permitindo que usuários adicionem notas contextuais a postagens que possam ser enganosas. Desde a sua criação em 2021, o programa tem sido totalmente baseado em contribuições humanas, com notas sendo avaliadas por uma comunidade descentralizada. Com a chegada de modelos de aprendizado de máquina, a X agora está testando uma abordagem híbrida que propõe a inclusão de notas geradas por IA no processo de validação.

Método proposto

O novo modelo, conforme publicado em um estudo recente por pesquisadores da X, mescla notas escritas por humanos com aquelas geradas por modelos de linguagem de grande porte (LLMs). Este sistema mantém a avaliação das notas restrita a seres humanos, garantindo que apenas as consideradas úteis sejam exibidas. “Permitir a criação automática de notas possibilitaria que o sistema operasse em uma escala e velocidade impossíveis para escritores humanos” (

“allowing automated note creation would enable the system to operate at a scale and speed that is impossible for human writers”

— Pesquisadores da X

).

A técnica de reinforcement learning from community feedback (RLCF) será utilizada para aprimorar a geração das notas, incorporando feedback diversificado da comunidade. Isso busca não apenas melhorar a acurácia das informações, mas também garantir que as notas geradas não sejam homogêneas.

Resultados e impacto

Embora o novo modelo tenha o potencial de aumentar significativamente a eficiência na verificação de informações, existem riscos associados ao uso de notas geradas por IA, como a produção de conteúdos persuasivos, porém imprecisos. Há um receio de que a presença de IA possa diminuir a participação humana, complicando a tarefa dos avaliadores na determinação da utilidade das notas. A pesquisa também considera a necessidade de métodos de verificação e autenticação para escritores e avaliadores humanos, além da personalização de LLMs para gerar notas mais relevantes para contextos semelhantes.

A colaboração entre humanos e IA oferece oportunidades para balancear a velocidade e a precisão, enriquecendo o processo de verificação de informações. “O objetivo não é criar um assistente de IA que diga aos usuários o que pensar, mas construir um ecossistema que empodere os humanos a pensar criticamente” (

“the goal is not to create an AI assistant that tells users what to think, but to build an ecosystem that empowers humans to think more critically”

— Pesquisadores da X

).

Futuras aplicações podem incluir a assistência de IA para escritores humanos e suporte na auditoria de notas, visando sempre preservar a veracidade e diversidade nas informações apresentadas.

Fonte: (TechXplore – Machine Learning & AI)