LLMs e cérebro humano criam representações de objetos de forma similar

São Paulo — InkDesign News —

A pesquisa sobre machine learning está avançando na intersecção entre a inteligência artificial (IA) e a compreensão do comportamento humano. Um novo estudo aponta que modelos de linguagem multimodal (MLLs) podem desenvolver representações de objetos semelhantes às dos seres humanos.

Contexto da pesquisa

Pesquisadores da Academia Chinesa de Ciências investigaram como os MLLs, como o ChatGPT-3.5 e o GeminiPro Vision 1.0, representam objetos naturais, como rochas e plantas. Este estudo pode trazer novas perspectivas para áreas como psicologia e neurociência, além de contribuir para o desenvolvimento de técnicas de IA que imitam processos biológicos.

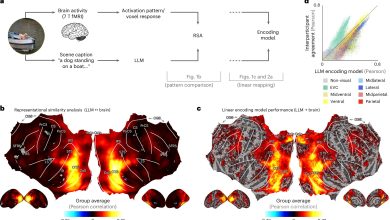

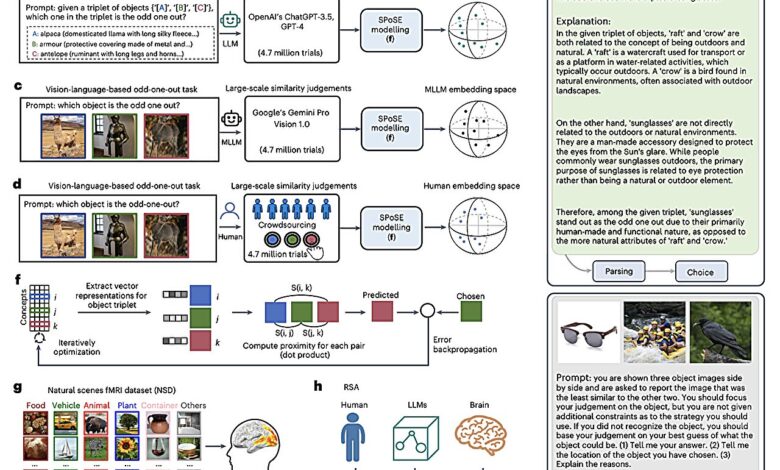

Método proposto

Os pesquisadores utilizaram tarefas de julgamento de tripletos, onde os modelos tinham que selecionar duas imagens de objetos que se assemelham mais entre três apresentadas. Eles coletaram 4,7 milhões de julgamentos para derivar emblemas de baixa dimensão que capturam estruturas de similaridade de 1.854 objetos naturais. Estes emblemas resultantes foram estáveis, preditivos e exibiram agrupamentos semânticos comparáveis às representações mentais humanas.

“Compreender como os humanos conceitualizam e categorizar objetos naturais oferece insights críticos em percepção e cognição”

(“Understanding how humans conceptualize and categorize natural objects offers critical insights into perception and cognition.”)— Changde Du, Pesquisador, Academia Chinesa de Ciências

Resultados e impacto

As análises revelaram que os emblemas se agruparam eficazmente em categorias significativas, como “animais” e “plantas”, sugerindo que os MLLs organizam objetos de maneira semelhante à mente humana. Os pesquisadores observaram forte alinhamento entre os emblemas dos modelos e padrões de atividade neural em áreas específicas do cérebro, como a área fusiforme e a área parahipocampal.

“As representações de objetos nos LLMs compartilham similaridades fundamentais que refletem aspectos chave do conhecimento conceitual humano”

(“…the object representations in LLMs share fundamental similarities that reflect key aspects of human conceptual knowledge.”)— Kaicheng Fu, Pesquisador, Academia Chinesa de Ciências

Os resultados sugerem que representações naturais de objetos podem emergir em MLLs após seu treinamento em grandes volumes de dados. Isso abre caminho para novas pesquisas que exploram como os MLLs representam objetos, potencialmente avançando sistemas de IA inspirados no cérebro.

Fonte: (TechXplore – Machine Learning & AI)