São Paulo — InkDesign News — Nos últimos anos, o campo de machine learning e deep learning tem atraído crescente atenção, mas muitos aspectos essenciais da interpretação e visualização de dados permanecem inexplorados. Compreender essas nuances pode ser crítico para a eficácia das soluções baseadas em dados.

Arquitetura de modelo

Os modelos de deep learning são frequentemente construídos sobre arquiteturas complexas, como Redes Neurais Convolucionais (CNN) e Redes Neurais Recorrentes (RNN). Essas estruturas são otimizadas para processar grandes volumes de informações e são utilizadas em variadas aplicações, desde reconhecimento facial até previsão de séries temporais.

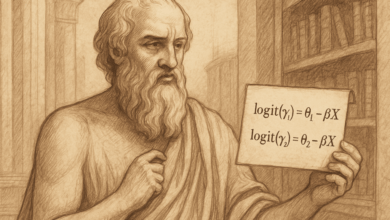

No entanto, a complexidade dessas redes também apresenta desafios significativos em termos de interpretabilidade. O entendimento do funcionamento interno desses modelos é crucial, pois uma visualização eficaz pode iluminar os padrões extraídos por eles. “A maior contribuição de uma imagem é quando nos força a notar o que nunca esperávamos ver.” (“The greatest value of a picture is when it forces us to notice what we never expected to see.”)

A maior contribuição de uma imagem é quando nos força a notar o que nunca esperávamos ver.

(“The greatest value of a picture is when it forces us to notice what we never expected to see.”)— John Tukey, Estatístico

Treinamento e otimização

O processo de treinamento requer ajustes de hiperparâmetros e cuidadosa escolha de dados. Isso tem um impacto significativo na precisão do modelo. Benchmarking adequados são essenciais para garantir que a performance do modelo seja comparável com outras soluções. Por exemplo, reduções no tempo de treinamento, associadas a aumentos na acurácia, têm sido um foco central de pesquisa.

A utilização de técnicas como o transfer learning é uma abordagem promissora para melhorar a eficiência do treinamento. Compreender as contribuições de cada variável no modelo também pode ser facilitado por técnicas de visualização, permitindo que os pesquisadores refine suas metodologias.

Resultados e métricas

Avaliar um modelo de machine learning vai além da acurácia. Métricas como precisão, recall e F1-score são igualmente importantes. Em muitos casos, uma visualização clara dos resultados pode facilitar a identificação de classes desbalanceadas ou outras questões que possam afetar a eficácia da implementação.

Além disso, a capacidade de transmitir insights extraídos dos dados será cada vez mais vital. Iniciativas educacionais que aprofundam o uso de data visualization em diversos contextos podem acelerar a adoção de soluções inovadoras.

Como próximos passos na pesquisa, é essencial explorar como a visualização de dados pode ser integrada com machine learning para gerar insights que não são imediatamente óbvios, tornando-se um recurso valioso em aplicações práticas que abrangem várias indústrias.

Fonte: (Towards Data Science – AI, ML & Deep Learning)