Cambridge, MIT — InkDesign News — Pesquisadores do MIT CSAIL desenvolveram o Feature Fields for Robotic Manipulation (F3RM), uma tecnologia que integra visão computacional e processamento de linguagem natural para permitir que robôs manipulem objetos desconhecidos em ambientes complexos, como armazéns e residências.

Tecnologia aplicada

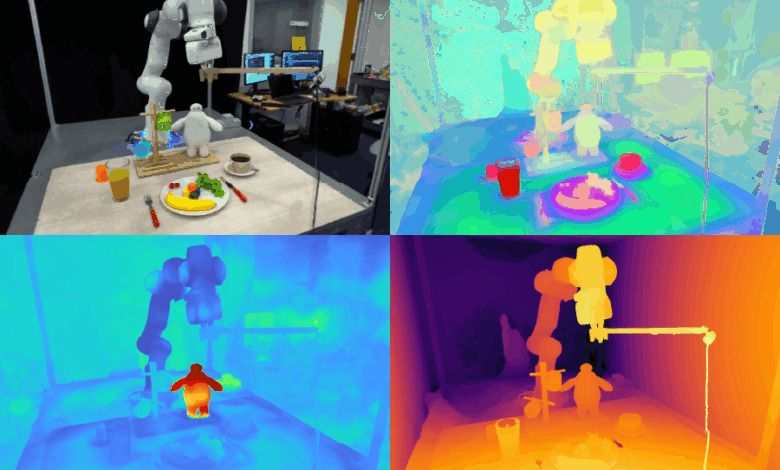

O sistema F3RM combina campos de radiação neural (NeRF) para reconstrução 3D com modelos fundacionais de visão CLIP, que mapeiam características semânticas em imagens 2D para representações 3D espaciais. A coleta dos dados ocorre por meio de uma câmera acoplada a um bastão, que captura cerca de 50 imagens em diferentes poses para criar um “gêmeo digital” do ambiente. A partir dessa base, o robô interpreta comandos textuais em linguagem natural, localizando objetos com base em descrições abertas, como “pegue a caneca alta”.

Desenvolvimento e testes

Durante os testes, o F3RM foi capaz de generalizar a manipulação para objetos não previamente treinados, como brinquedos de personagens de desenhos animados, utilizando a combinação do entendimento espacial e semântico. O sistema avalia diferentes opções de preensão considerando relevância, similaridade com demonstrações anteriores e possíveis colisões, executando a preensão com maior pontuação. Essa abordagem foi testada em ambientes simulando centros de distribuição e espaços domésticos, demonstrando eficácia em identificar e manusear objetos em meio a desordem e variações de embalagem.

Impacto e aplicações

Com capacidade para interpretar instruções abertas e lidar com milhares de itens, F3RM pode otimizar operações em centros de fulfillment, reduzindo erros na separação de pedidos e aumentando a eficiência de embalagens e envios. Sua arquitetura também viabiliza escalabilidade para ambientes maiores, como edifícios, e possibilita a integração em robôs personalizados para casas, ampliando a autonomia e a aplicabilidade da robótica em cenários reais. O próximo passo consiste em acelerar o sistema para que possa operar em tempo real, aplicando-o em tarefas dinâmicas de controle robótico.

“Fazer robôs que possam generalizar no mundo real é incrivelmente difícil. Queremos descobrir como fazer isso, então com este projeto buscamos um nível agressivo de generalização, de apenas três ou quatro objetos para qualquer coisa que encontrarmos no Edifício Stata do MIT.”

(“Making robots that can actually generalize in the real world is incredibly hard. We really want to figure out how to do that, so with this project, we try to push for an aggressive level of generalization, from just three or four objects to anything we find in MIT’s Stata Center.”)— Ge Yang, Pesquisador, MIT CSAIL

“Se eu mostrasse para uma pessoa como pegar uma caneca pela borda, ela poderia facilmente transferir esse conhecimento para pegar objetos com geometrias semelhantes, como tigelas, medidores ou até rolos de fita. Para robôs, alcançar esse nível de adaptabilidade tem sido bastante desafiador.”

(“If I showed a person how to pick up a mug by the lip, they could easily transfer that knowledge to pick up objects with similar geometries such as bowls, measuring beakers, or even rolls of tape. For robots, achieving this level of adaptability has been quite challenging.”)— William Shen, Doutorando, MIT CSAIL

F3RM representa um avanço no uso combinado de sensores visuais avançados e algoritmos de entendimento semântico para robótica adaptativa, com potencial para revolucionar processos industriais e ambientes domésticos.

Fonte: (Robohub – Robótica & Automação)