Modelo de deep learning permite robôs identificar propriedades de objetos ao manipular

Cambridge, MIT — InkDesign News — Pesquisadores do MIT, Amazon Robotics e Universidade da British Columbia desenvolveram um método baseado em machine learning que permite robôs identificarem propriedades físicas de objetos, como massa e rigidez, utilizando apenas sensores internos sem necessidade de câmeras ou sensores externos.

Contexto da pesquisa

A pesquisa aborda a capacidade de robôs para inferir propriedades físicas de objetos durante a manipulação, inspirando-se na propriocepção humana – a habilidade de perceber posição e movimento do próprio corpo. Tradicionalmente, esse tipo de tarefa depende de visão computacional ou sensores externos, métodos que podem ser caros e limitados em ambientes com baixa visibilidade.

Método proposto

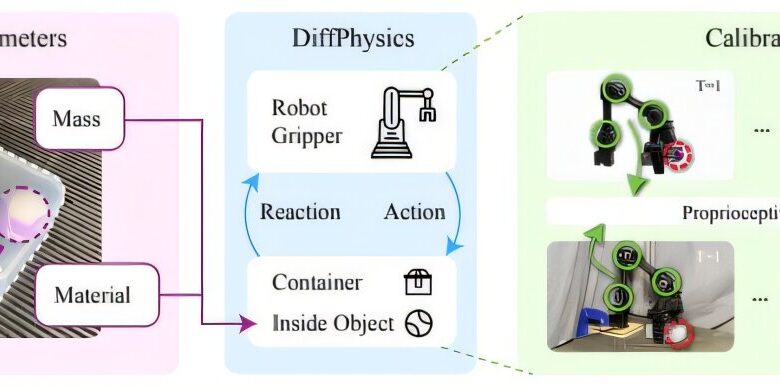

O time desenvolveu uma técnica que utiliza simuladores diferenciáveis para ajustar um modelo virtual do objeto e do robô conforme os dados captados pelos sensores internos, especificamente os codificadores das juntas do braço robótico. Esse modelo simula as interações físicas em tempo real e permite identificar parâmetros do objeto ao comparar as trajetórias simuladas com os sinais proprioceptivos reais.

Essa abordagem combina física diferenciável com algoritmos de machine learning para calibrar propriedades como massa, rigidez e outras características dinâmicas. O sistema executa as inferências rapidamente, a partir de uma única interação física, dispensando grandes conjuntos de dados para treinamento, característica que contribui para a robustez em cenários inéditos.

“Esta ideia é geral, e acredito que estamos apenas começando a explorar o que um robô pode aprender dessa forma. Meu sonho seria que robôs saíssem ao mundo, tocassem e movessem coisas em seus ambientes, descobrindo as propriedades de tudo que interagem por conta própria.”

(“This idea is general, and I believe we are just scratching the surface of what a robot can learn in this way. My dream would be to have robots go out into the world, touch things and move things in their environments, and figure out the properties of everything they interact with on their own.”)— Peter Yichen Chen, Pesquisador MIT

Resultados e impacto

Os testes mostraram que o método é capaz de estimar a massa e a rigidez de objetos com precisão comparável a técnicas complexas que usam visão computacional. Além disso, o baixo custo, a necessidade apenas dos sensores internos do robô e a rapidez do processo destacam seu potencial para aplicações em ambientes desafiadores, como áreas com baixa iluminação ou locais inacessíveis para câmeras, como entulhos pós-desastres.

Por utilizar a biblioteca Warp da NVIDIA para simulações diferenciáveis, o sistema proporciona uma modelagem precisa e eficiente para diversas propriedades físicas. Futuramente, os pesquisadores planejam integrar essa técnica com visão computacional para ampliar as capacidades multimodais de percepção robótica.

“Tecnicamente, desde que você conheça o modelo do objeto e como o robô pode aplicar força a ele, é possível determinar o parâmetro que deseja identificar.”

(“Technically, as long as you know the model of the object and how the robot can apply force to that object, you should be able to figure out the parameter you want to identify.”)— Chao Liu, Pesquisador MIT

Entre as possíveis aplicações, destacam-se a robótica para manipulação flexível em ambientes imprevisíveis, a aprendizagem rápida de novas habilidades por robôs e a adaptação dinâmica a mudanças no ambiente. Os próximos passos incluem testar a técnica em robôs com diferentes características, como robôs moles, e em objetos com propriedades mais complexas, como líquidos e materiais granulares.

Fonte: (TechXplore – Machine Learning & AI)