Machine learning auxilia decisões públicas, mas habilidades humanas são essenciais

São Paulo — InkDesign News —

A pesquisa recente sobre inteligência artificial (AI) e machine learning revela que, apesar da crescente automação, decisões complexas em setores públicos ainda exigem intervenção humana. As tecnologias que sustentam essas inovações estão em constante evolução, mas os desafios éticos e a responsabilidade sempre permanecem em discussão.

Contexto da pesquisa

A pesquisa conduzida por Jenny Eriksson Lundström, do Departamento de Informática e Mídia na Universidade de Uppsala, destaca a importância da transparência nas decisões assistidas por AI. Lundström enfatiza que, mesmo com algoritmos e machine learning, não se deve transferir a responsabilidade total para as máquinas em decisões sensíveis que impactam a vida humana.

Método proposto

A abordagem utilizada por Lundström inclui o estudo de decisões complexas em serviços públicos, analisando como algoritmos, especialmente aqueles baseados em regras, influenciam processos decisórios. Em particular, a pesquisa aborda o uso de sistemas de avaliação de risco e como estes podem inadvertidamente reforçar preconceitos sociais.

“Não podemos colocar a responsabilidade em uma máquina para fazer decisões sensíveis cujas consequências são difíceis de prever e onde o julgamento humano é necessário. Um sistema de AI pode seguir regras, compilar uma grande quantidade de informações e relatar resultados. Mas uma máquina não possui experiência de ser humano, portanto carece da habilidade de reconhecer o que significa ser humano.”

(“Regardless of the technology, we cannot place the responsibility on a machine to make sensitive decisions whose consequences are difficult to foresee and where human judgment is required. An AI system can follow rules, compile a large amount of information and report results. But a machine has no experience of being human and therefore lacks the ability to recognize what it means to be a human being.”)— Jenny Eriksson Lundström, Pesquisadora, Universidade de Uppsala

Resultados e impacto

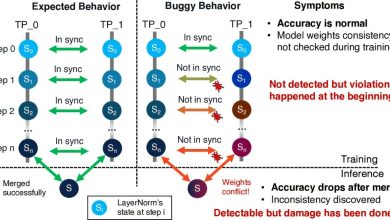

A pesquisa revelou que a aplicação de machine learning em decisões administrativas, embora ofereça eficiência, é limitada quando envolve julgamento ético e complexo. Lundström destaca quatro fatores essenciais que devem ser monitorados em decisões baseadas em AI: acuracidade material, ética, capacidade de explicação e segurança dos dados. A ausência desses critérios pode levar a decisões discriminatórias, como evidenciado em estudos de casos nos EUA, onde algoritmos influenciaram desfavoravelmente a liberação de prisioneiros.

“As decisões devem ser compreensíveis e passíveis de explicação, além de garantir que os dados sejam processados de forma segura e em conformidade com a legislação de privacidade.”

(“It must be possible to understand and explain every decision, and be able to demonstrate the basis on which the decision was made in accordance with the principle of public access to official records.”)— Jenny Eriksson Lundström, Pesquisadora, Universidade de Uppsala

Os resultados da pesquisa sugerem que, enquanto os sistemas de AI podem servir como suporte em decisões públicas, a responsabilidade final deve permanecer com os humanos, enfatizando a importância do contato interpessoal nas decisões administrativas.

As aplicações futuras da pesquisa incluem aprimorar os processos decisórios em serviços públicos, garantindo que as implementações de AI respeitem os princípios éticos e legais, além de promover um debate contínuo sobre a integração da tecnologia em contextos sensíveis.

Fonte: (TechXplore – Machine Learning & AI)