São Paulo — InkDesign News —

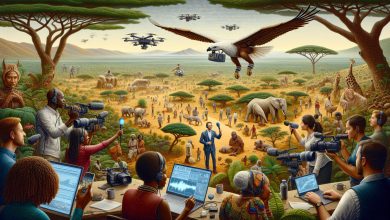

Uma nova abordagem em machine learning está revolucionando a forma como treinamos robôs para interagir com ambientes do mundo real. Pesquisadores do Laboratório de Ciência da Computação e Inteligência Artificial do MIT desenvolveram um método que utiliza AI para criar cenários de treinamento diversos e realistas.

Contexto da pesquisa

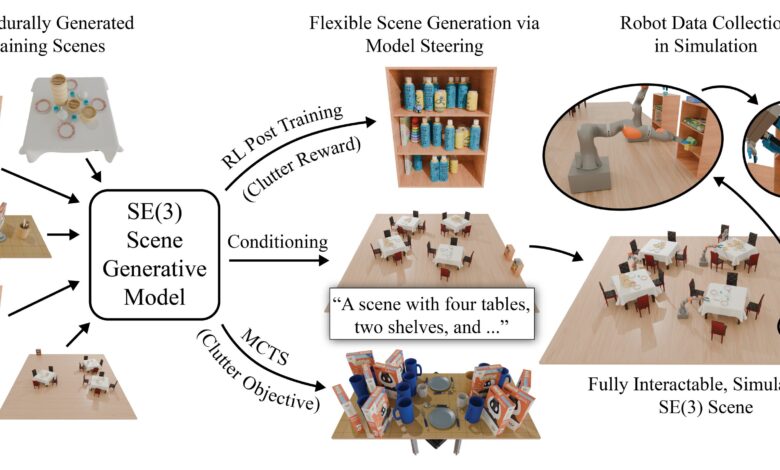

Os robôs necessitam de demonstrações práticas para compreender como manusear, empilhar e posicionar objetos em diferentes ambientes. Entretanto, a coleta de dados de treinamento pode ser longa e imprecisa, levando os engenheiros a recorrer a simulações. O método denominado “Geração de Cena Direcionável” (Steerable Scene Generation) promete solucionar essa limitação, criando digitalmente cenários que simulam interações cotidianas.

Método proposto

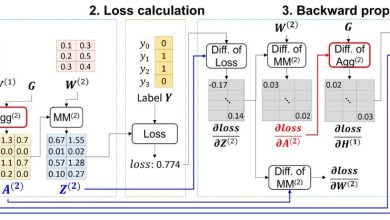

O modelo utiliza um sistema de difusão que gera visuais a partir de ruído aleatório, guiando a criação de ambientes 3D a partir de uma biblioteca de mais de 44 milhões de salas modeladas. A abordagem principal é uma busca em árvore Monte Carlo (MCTS), permitindo a criação de cenas complexas e realistas por meio de um processo de tomada de decisão sequencial. A técnica foi aplicada para construir cenários que eram, em média, 34 itens em comparação aos 17 objetos comuns em cenas anteriores.

“Nós somos os primeiros a aplicar MCTS na geração de cenas, enquadrando a tarefa como um processo de tomada de decisão sequencial.”

(“We are the first to apply MCTS to scene generation by framing the scene generation task as a sequential decision-making process.”)— Nicholas Pfaff, Ph.D. Student, MIT

Resultados e impacto

Os testes demonstraram que o sistema alcançou taxas de precisão de 98% ao criar cenários de prateleiras de despensa e 86% para mesas de café da manhã. Essas métricas superam em pelo menos 10% métodos anteriores, como MiDiffusion e DiffuScene. Além disso, o sistema se adapta a instruções diretas dos usuários, gerando ambientes que atendem a descrições específicas com precisão impressionante.

Os pesquisadores afirmam que este projeto é um primeiro passo em direção à criação de objetos e cenas completamente novos. “Um insight chave de nossas descobertas é que está tudo bem se as cenas que pré-treinamos não se assemelhem exatamente às cenas que realmente queremos,” completou Pfaff.

Futuramente, o objetivo é integrar objetos articulados e melhorar a realismo ao incorporar dados do mundo real em seus modelos. Isso poderá expandir ainda mais as possibilidades de criação de dados de treinamento, favorecendo a construção de robôs mais adaptáveis e capazes de operar em ambientes complexos.

Fonte: (TechXplore – Machine Learning & AI)