São Paulo — InkDesign News —

Pesquisas recentes sobre machine learning e inteligência artificial (AI) têm revelado a crescente utilização de ferramentas geradoras de conteúdo para criar vídeos enganosos que promovem produtos duvidosos nas redes sociais.

Contexto da pesquisa

O aumento do uso de AI generativa possibilitou que vídeos manipulados, como aqueles que afirmam aumentar a masculinidade, sejam produzidos em grande escala com supervisão humana mínima. Essa dinâmica tem suscitado preocupações sobre a saúde pública e a manipulação dos usuários na Internet.

Método proposto

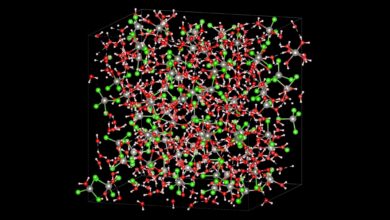

O estudo conduzido pela Resemble AI utiliza um serviço de detecção de deepfakes para identificar a autenticidade dos vídeos. Essa abordagem analisa a presença de vozes e imagens geradas por AI, entrevistando especialistas na área para melhor compreensão dos dados. O uso de Redes Neurais Convolucionais (CNN) e Generative Adversarial Networks (GAN) tem sido comum para a criação desses vídeos e, por conseguinte, para a sua detecção.

Resultados e impacto

Com base em dados coletados, “como visto neste exemplo, conteúdos gerados por AI estão sendo usados para comercializar suplementos com afirmações exageradas ou não verificadas, potencialmente colocando a saúde dos consumidores em risco” (

“as decepcionantes criações de conteúdo por AI estão ajudando a espalhar desinformação”

— Zohaib Ahmed, CEO, Resemble AI

). Existem centenas de vídeos no TikTok que promovem remédios para a disfunção erétil utilizando celebridades manipuladas digitalmente. Esse cenário torna a moderação de conteúdos polêmicos uma tarefa complicada, pois mesmo com a remoção, versões semelhantes rapidamente reaparecem.

A pesquisa conclui que “AI é uma ferramenta útil para golpistas que procuram criar grandes volumes de conteúdo de baixo custo” (

“é uma maneira barata de produzir publicidade”

— Abbie Richards, Pesquisadora de desinformação

), indicando a necessidade de novas soluções para abordar esses desafios na era digital.

As aplicações futuras incluem o desenvolvimento de técnicas mais robustas de detecção e uma melhor regulação do uso de AI em plataformas sociais, proporcionando assim um ambiente digital mais seguro para os usuários.

Fonte: (TechXplore – Machine Learning & AI)