São Paulo — InkDesign News — Ferramentas de anotações por IA estão se tornando comuns em reuniões, mas apresentam riscos significativos em segurança cibernética, potencialmente comprometendo a privacidade e a integridade operacional de organizações.

Vetor de ataque

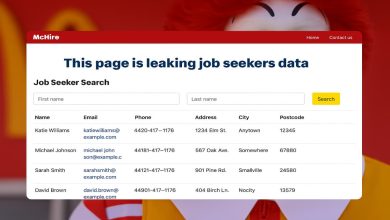

As aplicações de anotações que capturam diálogos em reuniões podem se tornar vetores de ataque, especialmente aquelas que operam fora das diretrizes corporativas. Muitas dessas ferramentas possuem capacidades de segurança limitadas, tornando-as vulneráveis a exposições indevidas de dados sensíveis. Por exemplo, a falta de conformidade com padrões como SOC 2 e GDPR aumenta a possibilidade de vazamentos de informações.

A proliferacão rápida de contas em empresas, com um caso reportando cerca de 800 contas de anotadores criadas em apenas 90 dias devido ao compartilhamento informal, evidencia um cenário preocupante para a segurança de dados.

Impacto e resposta

O impacto do uso inadequado de anotadores de IA abrange diversas áreas. Transcrições não autorizadas podem ser utilizadas em litígios, uma vez que conversas casuais sobre estratégias ou recursos humanos podem se tornar provas. “Transcrições de anotadores já estão surgindo em litígios” (“Transcripts from notetakers are already surfacing in litigation”)— especialista em segurança, Nome, Cargo, Empresa.

Além disso, muitos fornecedores transferem a responsabilidade pela obtenção de consentimento para os clientes, adicionando cláusulas de indenização que podem sobrecarregar as empresas em casos de ações legais.

Análise e recomendações

Para mitigar riscos, é fundamental que as organizações estabeleçam processos claros sobre o uso de ferramentas de anotação por IA. Recomenda-se especificar quem pode ativar tais ferramentas e aonde as transcrições serão armazenadas. É vital que haja uma revisão humana dos registros gerados para garantir a precisão e evitar “manipulação” nas anotações, onde os participantes moldam suas falas para garantir que suas observações sejam capturadas de maneira benéfica.

As empresas devem também revisar contratos com fornecedores, garantindo que haja proibições contra a reutilização de dados para treinamento adicional e revisar cláusulas de consentimento para evitar riscos legais futuros.

As implicações de longo prazo incluem a necessidade contínua de atualização das políticas de gestão de riscos e conformidade legal à medida que as tecnologias de IA evoluem e se tornam mais integradas aos processos de negócios.

Fonte: (Dark Reading – Segurança Cibernética)