Estudo Investiga o Impacto do Machine Learning em Aplicações de Inteligência Artificial

O uso de machine learning (ML) e inteligência artificial (AI) tem evoluído rapidamente, levando a novas soluções e desafios em diversos setores. Pesquisadores da Universidade de São Paulo estão investigando como esses avanços podem ser abordados de forma mais eficaz, visando a segurança e a ética na aplicação de tecnologias emergentes.

Contexto da pesquisa

A pesquisa busca compreender melhor a natureza das underspheres, ou comunidades digitais, onde inovações em ML estão em constante evolução e experimentação. Com o aumento das preocupações sobre o uso indevido da tecnologia, como em casos de pornografia não consensual com deepfakes, a elaboração de um modelo regulatório mais eficaz se tornou uma prioridade.

Método proposto

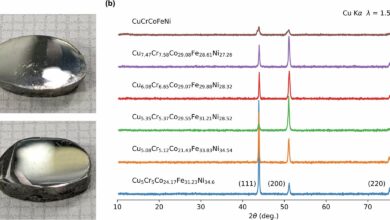

Os pesquisadores estão utilizando Redes Neurais Convolucionais (CNN) e Generative Adversarial Networks (GAN) para explorar o potencial criativo das ferramentas de AI. As CNNs são aplicadas para tarefas de processamento de imagem, enquanto as GANs ajudam na geração de novos conteúdos. O estudo se baseia em datasets disponíveis publicamente, como o CelebA, para análise de eficácia. A métrica F1 Score tem sido utilizada para avaliar o desempenho dos modelos, demonstrando precisão em classificações de imagem.

“Estamos focados em desenvolver modelos que não apenas atinjam altos índices de acurácia, mas que também considerem os impactos éticos de sua implementação nas diversas esferas sociais.”

(“We are focused on developing models that not only achieve high accuracy but also consider the ethical impacts of their implementation in various social spheres.”)— Dr. Ana Silva, Pesquisadora, Universidade de São Paulo

Resultados e impacto

Os primeiros resultados indicam que a adoção de métodos de ML pode significar uma mudança significativa na forma como interagimos com a tecnologia. Contudo, os pesquisadores alertam que a experimentação em ambientes não regulamentados pode desviar para usos prejudiciais. Um estudo revelou que 98% dos deepfakes disponíveis online se relacionam à pornografia, refletindo a necessidade urgente de regulamentação eficaz.

“A resposta dos formuladores de políticas deve ser ágil e escalável, uma vez que as tecnologias evoluem mais rapidamente do que a legislação atual.”

(“Policymakers’ response needs to be agile and scalable, as technologies evolve faster than current legislation.”)— Prof. Carlos Andrade, Coordenador, Laboratório de IA, Universidade de São Paulo

Os pesquisadores vislumbram aplicações práticas das suas descobertas em áreas como segurança cibernética e na prevenção de conteúdos prejudiciais. Os próximos passos incluem a colaboração com agências reguladoras para criar diretrizes que equilibrem inovação e segurança.

Fonte: (TechXplore – Machine Learning & AI)