São Paulo — InkDesign News —

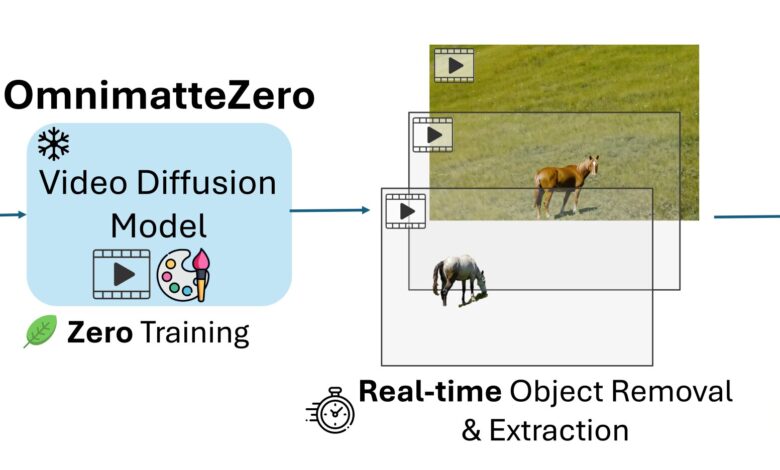

A nova pesquisa desenvolvida por uma equipe da Bar-Ilan University apresenta uma abordagem inovadora de machine learning, chamada OmnimatteZero, para separação de objetos e fundos em vídeos em tempo real, sem a necessidade de treinamento extensivo.

Contexto da pesquisa

A pesquisa, conduzida pelo Dr. Dvir Samuel e pelo Prof. Gal Chechik, aborda as limitações de métodos tradicionais que requerem modelos de inteligência artificial treinados com milhões de exemplos rotulados. A equipe afirma que a técnica OmnimatteZero simplifica o processo de separação de objetos, preservando elementos complexos como cabelos e reflexos.

Método proposto

O método utiliza uma abordagem generativa, tirando proveito de modelos de difusão de vídeo pré-treinados. Em vez de se basear em aprendizado supervisionado caro, a técnica aplica conceitos de imagem-completude, adaptados para o domínio do vídeo. Com um sistema de autoatenção embutido, é possível identificar efeitos de objetos em múltiplos quadros sem treinamento prévio.

“No sistema de decomposição de vídeo, o algoritmo deve identificar os efeitos que um objeto impõe na cena e removê-lo ou extraí-lo de maneira que pareça natural”

(“In video decomposition systems, the algorithm must identify the effects an object imposes on the scene, and then remove or extract it in a way that looks natural.”)— Dr. Dvir Samuel, Pesquisador, Bar-Ilan University

Resultados e impacto

A pesquisa indica que o OmnimatteZero resulta em uma separação eficaz de camadas em apenas 0,04 segundos por quadro em uma GPU A100, eliminando a espera de minutos para processamento. Os resultados demonstram que modelos dedicados para a separação de vídeo não são necessários, e a eficácia é mantida utilizando apenas um modelo de geração de vídeo existente.

A metodologia proposta tem um impacto potencial significativo na edição de vídeos, permitindo a reutilização de cenas em tempo real, o que pode beneficiar criadores de conteúdo, designers e pesquisadores de IA. Dr. Samuel também menciona um próximo passo voltado para a sincronização sonorizada, onde sons indesejados devem ser removidos junto com os objetos visuais.

Fonte: (TechXplore – Machine Learning & AI)