Plataforma de computação analógica aumenta escalabilidade com AI

Machine Learning e Avanços em Computação Analógica

Pesquisas em machine learning estão se expandindo com o desenvolvimento de novas abordagens para a computação analógica. Inovações recentes possibilitam a melhoria de plataformas de computação a partir de métodos mais eficientes e escaláveis.

Contexto da pesquisa

Pesquisadores da Virginia Tech, do Oak Ridge National Laboratory e da University of Texas at Dallas estão explorando formas de aumentar a eficiência dos sistemas de computação analógica. Estes sistemas utilizam quantidades físicas contínuas, como tensão e frequência, para representar dados, contrastando com os computadores digitais que utilizam estados binários.

Método proposto

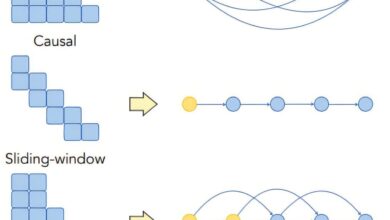

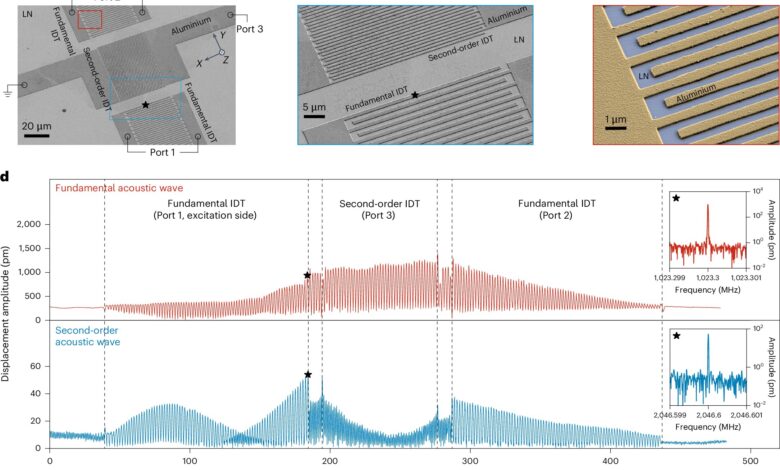

A equipe desenvolveu uma abordagem chamada “sintético de domínio” para codificar informações em diferentes frequências em um único dispositivo, eliminando a necessidade de múltiplos componentes físicos. O modelo enfatiza o uso de dispositivos acústicos integrados a plataformas de niobato de lítio para realizar operações matemáticas, como multiplicações de matrizes.

“Estamos vendo vantagens das redes neurais físicas (PNNs) em aplicações de IA,”

(“I am seeing advantages of physical neural networks (PNNs) in AI applications,”)— Linbo Shao, Autor Sênior, Virginia Tech

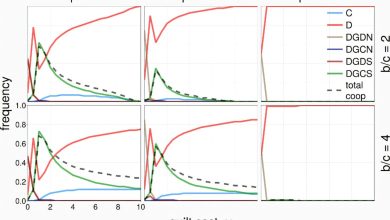

O sistema inicialmente desenvolvido demonstrou resultados significativos em tarefas de classificação de dados.

Resultados e impacto

A estratégia nova eliminou a necessidade de integrar um maior número de componentes físicos, resultando em uma performance de 98,2% na precisão de tarefas de classificação usando uma rede neural aplicada a dispositivos de ondas acústicas.

“A abordagem do domínio sintético pode ser aplicada a dispositivos emergentes, mesmo que haja apenas alguns disponíveis nas etapas iniciais de P&D,”

(“The synthetic domain approach could be applied to more emerging devices, even if there are only a few devices available at early R&D stages.”)— Linbo Shao, Autor Sênior, Virginia Tech

O trabalho abriu novas possibilidades para a escalabilidade das arquiteturas de computação analógica em algoritmos de machine learning, mantendo performance e eficiência.

Os pesquisadores buscam melhorar ainda mais o desempenho e a escalabilidade de suas plataformas, visando atender a modelos de redes neurais mais complexos no futuro.

Fonte: (TechXplore – Machine Learning & AI)