São Paulo — InkDesign News — Pesquisas recentes envolvendo machine learning e inteligência artificial (IA) destacam novos desafios na integração desses sistemas em produtos comerciais, especialmente em relação à privacidade dos dados e à ética no uso da tecnologia.

Contexto da pesquisa

Meta, empresa controladora do Facebook, Instagram, Threads e WhatsApp, lançou um novo assistente de IA pessoal, alimentado pelo modelo de linguagem Llama 4. Embora ofereça interações naturais e uma interface refinada, o sistema tem suscitado preocupações científicas e éticas devido à forma como coleta e utiliza dados dos usuários.

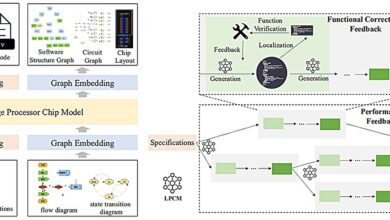

Método proposto

O chatbot da Meta opera com um modelo de linguagem grande (LLM) de última geração e é projetado para acumular informações detalhadas sobre os usuários ao longo de conversas. Diferentemente de concorrentes que utilizam modelos baseados em assinaturas para preservar a privacidade do usuário, o modelo da Meta é inserido em um ecossistema integrado, possibilitando a coleta de dados cruzados entre várias plataformas para aprimorar a precisão dos perfis comerciais.

“Meta AI foi construído para te conhecer”

(“Meta AI is built to get to know you”)— Meta, anúncio oficial

Resultados e impacto

Estudos e análises indicam que o chatbot mantém cópias de todas as interações, exigindo ações específicas para a exclusão desses dados. Pesquisas científicas mostram que humanos tendem a compartilhar informações íntimas com chatbots tanto quanto com pessoas, o que pode resultar em perfis comerciais detalhados e campanhas publicitárias direcionadas, fonte de debate no campo da ética da IA.

“Temos a transparência e o controle durante o uso, o que não difere dos nossos outros aplicativos”

(“It provides transparency and control throughout and is no different to their other apps”)— Meta, resposta oficial

Além da coleta, há preocupações sobre a manipulação sutil do comportamento do usuário. A possibilidade de recomendações inseridas sem identificação de conteúdo patrocinado representa uma fronteira delicada no marketing, levantando questões sobre a responsabilidade e a jurisdição ética dos assistentes inteligentes.

Pesquisas futuras deverão focar no desenvolvimento de modelos que equilibrem desempenho com a proteção da privacidade do usuário, incluindo opções de geração de receita por assinatura, ao invés de coleta massiva de dados pessoais. Tais abordagens são essenciais para garantir a integridade do campo da IA e fomentar a confiança do consumidor.

Para saber mais sobre temas relacionados, veja também nosso conteúdo especial em machine learning e deep learning.

Fonte: (TechXplore – Machine Learning & AI)