São Paulo — InkDesign News — O uso de machine learning está se expandindo rapidamente em várias indústrias, com algoritmos sofisticados sendo desenvolvidos para otimizar previsões e análises. Um exemplo significativo é o uso de Gradient Descent para treinamento de modelos de regressão linear.

Arquitetura de modelo

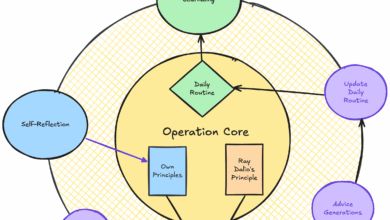

O modelo proposto utiliza supervised learning com um conjunto de dados rotulados, onde a relação entre as variáveis de entrada e saída é analisada. O modelo prevê valores contínuos com base em várias características de entrada.

“Os algoritmos de aprendizado supervisionado usam dados rotulados para prever resultados e reconhecer padrões.”

(“Supervised learning algorithms use labeled datasets to predict outcomes and recognize patterns.”)— Autor, Instituição

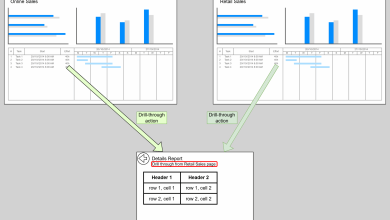

O cálculo da previsão é feito através de uma função denominada hipótese. Ao aplicar o Batch Gradient Descent, o algoritmo calcula as contribuições de cada parâmetro, ajustando-os para minimizar a função de custo que mede o erro dos dados preditivos.

Treinamento e otimização

A função de custo, definida como o Mean Squared Error (MSE), é a média do erro ao longo de todos os exemplos de treinamento. Durante o processo de treinamento, o modelo ajusta os parâmetros utilizados na previsão para diminuir essa função de custo.

“O objetivo da regressão linear é minimizar a diferença (MSE) entre os valores previstos e os reais.”

(“The objective of linear regression is to minimize the gap (MSE) between predicted values and actual values.”)— Autor, Instituição

O Stochastic Gradient Descent (SGD) é uma variante que utiliza um único exemplo de treinamento por vez, tornando o treinamento mais rápido, especialmente em grandes conjuntos de dados. Este método incorpora um elemento de aleatoriedade no processo de otimização, o que pode ajudar na busca por melhorias na convergência.

Resultados e métricas

Após o treinamento do modelo, foram obtidas métricas como o MSE de 1.5752 e o R-quadrado de 0.0206, indicando uma correlação variável entre as características de entrada e a variável de saída. Além disso, o tempo de treinamento foi otimizado, permitindo que o modelo convergisse mais rapidamente para o mínimo global.

“Considerar os trade-offs de várias abordagens de modelagem é essencial para alcançar resultados ótimos.”

(“Considering the trade-offs of various modeling approaches against specific objectives is essential for achieving optimal results.”)— Autor, Instituição

No futuro, aplicações práticas desse modelo podem incluir fraudes em transações de cartões de crédito e otimização de outros sistemas financeiros, utilizando técnicas de deep learning para melhorar a precisão dos modelos preditivos.

Fonte: (Towards Data Science – AI, ML & Deep Learning)